Lunedì 27 aprile, al TP Future Insights, un cliente ci ha fatto una domanda molto interessante.

Non ci ha chiesto di parlare di un titolo. Ci ha chiesto di spiegare un ragionamento riguardante il nostro portafoglio THÉMA.

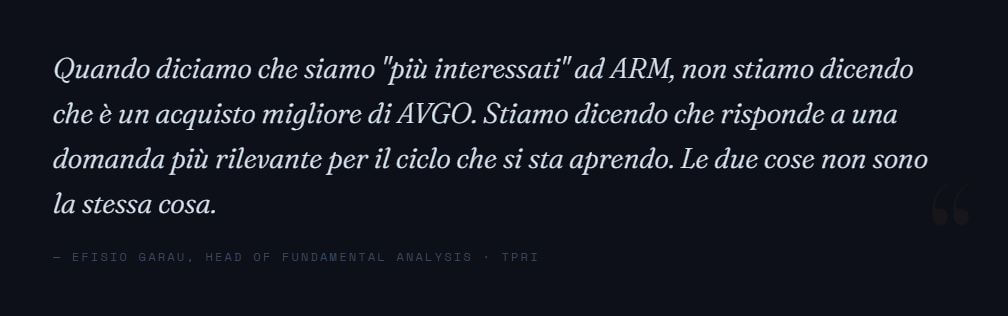

“Perché guardate con più interesse ad ARM rispetto ad AVGO? Broadcom ha fondamentali migliori adesso.”

Aveva ragione sui fatti. Non c’è niente da contestare: AVGO ha fondamentali migliori adesso. Se ci avessero chiesto “quale dei due ha i numeri migliori oggi”, avremmo risposto Broadcom senza esitare.

Ma quella non è la domanda giusta da fare a un investimento di lungo termine.

Due giorni dopo, mercoledì 29 aprile, le Big Tech hanno pubblicato le trimestrali. Quattro conference call chiave in una sera. E quello che è emerso, non dalle nostre proiezioni, ma dai documenti depositati alla SEC, ha risposto alla domanda del lunedì in modo più diretto di quanto avremmo potuto fare noi.

Questa newsletter è quella risposta.

Partiamo dai numeri esatti, verificati sulle press release ufficiali depositate alla SEC il 29 aprile 2026.

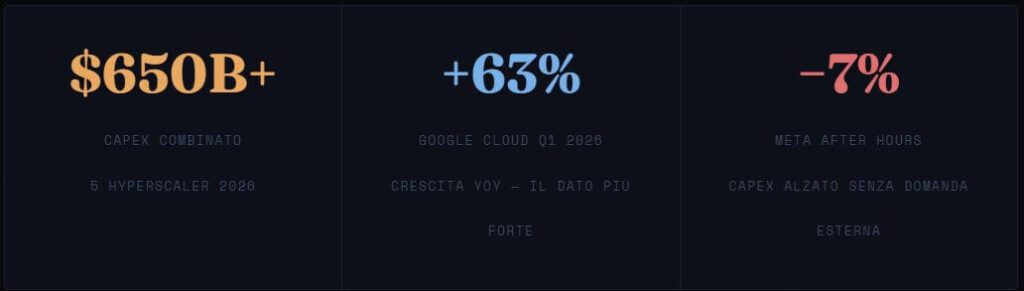

Alphabet Q1 2026: revenue $109.9 miliardi (+22% YoY). Google Cloud +63% a $20.03 miliardi, la crescita più forte in anni, con backlog quasi raddoppiato a oltre $460 miliardi. CapEx Q1: $35.7 miliardi. Guidance CapEx 2026 alzata a $180-190 miliardi. Sundar Pichai in conference call: “Siamo vincolati dalla potenza di calcolo nel breve termine. I ricavi del cloud sarebbero stati superiori se avessimo potuto soddisfare tutta la domanda“. Titolo: +6% after hours.

Microsoft Q3 FY2026 (gennaio-marzo 2026): revenue $82.89 miliardi, sopra il consensus di $81.46 miliardi. Azure +40% (39% a valuta costante), un punto sopra il tetto della guidance 37-38%. AI annualized revenue: $37 miliardi, +123% YoY. CapEx Q3: $31.9 miliardi, sotto le attese di $35.3 miliardi, notizia positiva. Ma la CFO Amy Hood ha poi alzato la guidance CapEx per l’intero 2026 a $190 miliardi, $35 miliardi sopra il consensus precedente di $154.6 miliardi, citando $25 miliardi di costi aggiuntivi per il rincaro dei componenti hardware. Titolo: -3% after hours.

Amazon Q1 2026: net sales $181.5 miliardi (+17% YoY). AWS +28% a $37.59 miliardi, il ritmo più veloce in 15 trimestri. AWS operating income $14.2 miliardi, margine del 37.7%. CapEx Q1: $44.2 miliardi. Chips business: $20 miliardi di revenue annualizzata, crescita triple digit YoY. Free cash flow trailing twelve months: $1.2 miliardi, -95% YoY per l’accelerazione della spesa. Titolo: -3% after hours.

Meta Q1 2026: revenue $56.31 miliardi (+33% YoY). Ad impressions +19%, prezzo per ad +12%. CapEx Q1: $19.84 miliardi. Guidance CapEx 2026 alzata da $115-135 a $125-145 miliardi, citando “aumento dei prezzi dei componenti hardware e costi extra per i data center”. Titolo: -7% after hours.

Quattro report. Tutti con CapEx in aumento. Tutti con numeri sopra o in linea con le attese. Eppure: Alphabet +6%, Microsoft piatta poi negativa, Amazon -3%, Meta -7%.

Mercoledì sera, guardando queste reazioni in parallelo, ho cercato di capire la logica sottostante. Non è complicata. Una volta che la vedi, è quasi ovvia.

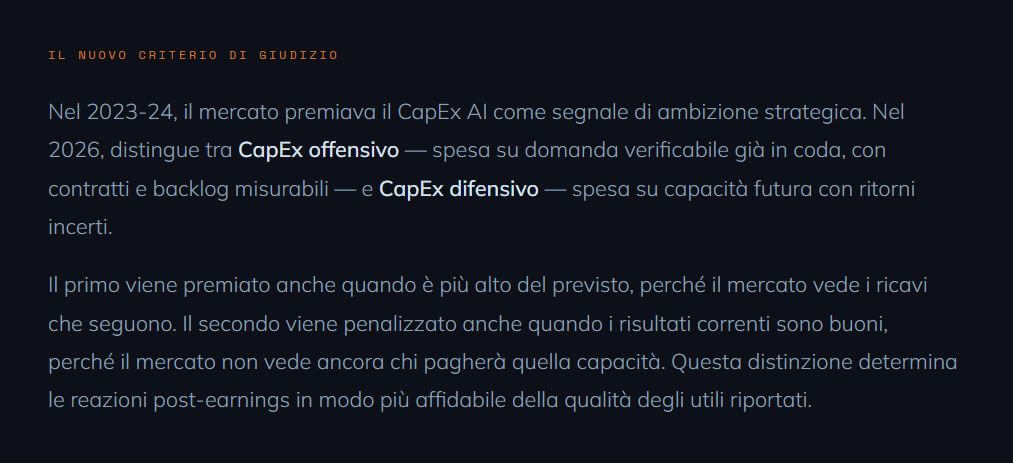

Il mercato sta premiando chi spende su domanda già in coda. Sta penalizzando chi spende scommettendo su domanda futura.

Alphabet ha mostrato che Google Cloud stava lasciando revenue sul tavolo per mancanza di capacità. Ogni dollaro di CapEx insegue contratti già firmati e clienti già in attesa. Pichai ha detto che i ricavi del cloud sarebbero stati più alti se avessero potuto soddisfare la domanda. Il mercato legge questo come CapEx offensivo: ogni dollaro speso oggi cattura revenue già in coda.

Meta ha alzato il CapEx per costruire infrastruttura principalmente per uso interno, i suoi modelli, i suoi sistemi pubblicitari, la sua strategia AI. Non c’è un cliente esterno che aspetta. Il mercato legge questo come CapEx difensivo: necessario per non perdere posizione competitiva, ma senza un moltiplicatore di revenue esterno verificabile nel breve. Il risultato è un titolo che scende anche con utili sopra le attese.

Microsoft è il caso più sfumato. Azure re-accelera al 40%, positivo. Il CapEx trimestrale di $31.9 miliardi è sotto le attese, positivo. Ma la guidance annuale a $190 miliardi è molto sopra il consensus, e Amy Hood ha attribuito $25 miliardi di quella cifra al rincaro dei componenti hardware, non a nuova domanda. Il mercato ha premiato Azure e penalizzato la sorpresa sul CapEx annuale. Risultato: reazione mista che si è trascinata nel rosso nelle ore successive.

Amazon è il caso più interessante perché i numeri operativi sono i migliori del gruppo, AWS +28% su una base di $37.6 miliardi è straordinario. Ma il free cash flow trailing a 12 mesi è crollato del 95%. Il mercato non sta dicendo che Amazon ha torto sulle sue prospettive AI. Sta dicendo che vuole vedere la distanza tra spesa e ritorno ridursi in modo misurabile, non solo promessa in call.

Quello che stiamo osservando non è paura dell’AI. È maturità del mercato. I tassi reali sono positivi, i Treasury decennali rendono sopra il 4%, e ogni dollaro immobilizzato in CapEx AI ha un costo di opportunità reale. La domanda “quando e quanto”, prima quasi assente, è diventata il principale driver delle reazioni post-earnings.

Chi produce hardware che consuma meno energia a parità di prestazioni non sta vendendo un chip migliore. Sta vendendo la soluzione al problema più urgente dell’intero settore.

E questa è la porta attraverso cui entra il resto di questa newsletter.

Se vuoi capire già adesso come tutto questo si traduce in decisioni operative, prenota direttamente una call gratuita con noi.

C’è una forza che collega il CapEx da $650 miliardi alla tesi sui semiconduttori. È semplice da dire, difficile da vedere finché non la cerchi.

L’energia è diventata l’arbitro del ciclo AI. Non la tecnologia, non il talento, non il capitale. L’energia, la sua disponibilità, il suo costo, la sua affidabilità, è il vincolo che determina chi riesce a costruire infrastruttura AI, dove, a che velocità, e con quali economie.

Bloomberg ha stimato che quasi la metà di tutti i progetti di data center AI negli USA sarà ritardata quest’anno. Non per mancanza di chip. Non per mancanza di soldi. Per mancanza di allacciamenti alla rete elettrica. Le code di interconnessione negli USA si estendono da 3 a 5 anni. I terreni con energia a basso costo sono quasi esauriti. I diritti sull’acqua per il raffreddamento sono sotto scrutinio regolatorio in tutto l’ovest americano.

Microsoft, Google e Amazon, tre aziende con più liquidità disponibile di molti stati sovrani, non riescono ad avere un allaccio elettrico in tempo utile. Questo non è un problema che si risolve con più soldi. È un vincolo fisico. E i vincoli fisici non si comprano via.

Il dato Microsoft di questa settimana lo rende concreto: $25 miliardi del CapEx aggiuntivo 2026 è dovuto al rincaro dei componenti hardware. Non a nuova domanda, non a nuovi data center, al costo dei componenti. Chi produce chip che fanno le stesse cose consumando meno energia risolve direttamente quel problema. Non come feature aggiuntiva. Come risposta al vincolo strutturale più urgente del settore.

Il vincolo macro dell’energia crea una pressione strutturale verso l’efficienza energetica nei semiconduttori. Quella pressione favorisce sistematicamente l’architettura ARM rispetto agli x86. E quella preferenza degli hyperscaler si traduce in royalties crescenti per ARM, indipendentemente da chi costruisce il chip fisicamente.

Per capire perché ARM è diventata rilevante nei data center, bisogna capire cosa sta cambiando nell’AI, non a livello di modelli, ma a livello di architettura operativa.

Dal 2022 al 2025, l’AI è stata un sistema di risposta. Scrivi qualcosa, il modello risponde. Lineare, sequenziale. Questo ha alimentato la domanda di GPU in modo esplosivo, la GPU è il cuore dell’inferenza, il processo attraverso cui il modello genera la risposta. Nvidia ne ha beneficiato enormemente. La logica era diretta: più AI, più GPU.

Adesso quella logica si sta incrinando. Non perché le GPU diventino meno importanti. Perché il paradigma operativo dell’AI sta cambiando.

L’AI agentica è qualcosa di strutturalmente diverso. Non risponde, pianifica, esegue, coordina. Un agente AI riceve un obiettivo e lo persegue autonomamente: chiama strumenti, interroga API, gestisce memoria, delega subtask ad altri agenti, monitora risultati, corregge errori in tempo reale. Non fa una singola inferenza. Ne fa decine, a volte centinaia, per completare un singolo task complesso.

Pensa alla differenza concreta. Un chatbot AI è come chiedere a un assistente: “qual è il fatturato medio delle aziende del mio settore?” Un agente AI è come dire: “analizza i bilanci degli ultimi tre anni dei miei dieci principali competitor, identifica dove i loro margini stanno crescendo più velocemente dei miei, e preparami una presentazione per la prossima riunione del CDA.” Stessa tipologia di richiesta. Complessità computazionale completamente diversa, non di un fattore 2 o 3, ma di un fattore 100 o più.

ARM stima che i sistemi multi-agente genereranno fino a 15 volte più token per utente rispetto ai chatbot. E questo ha una conseguenza precisa sull’hardware necessario.

Nei workflow dell’AI agentica, le CPU rappresentano il 50-90% della latenza totale. La GPU fa ancora l’inferenza, ma tra una chiamata e l’altra è la CPU che orchestra tutto, tool call, API request, gestione della memoria, scheduling degli agenti in parallelo. Quando hai decine di agenti che fanno centinaia di richieste contemporaneamente, la GPU rimane spesso in attesa. Non perché sia lenta, ma perché la CPU non riesce a coordinare tutto abbastanza rapidamente.

Questo si chiama il problema di orchestrazione. Ed è il collo di bottiglia che nessuno guardava, finché l’adozione dell’AI agentica ha reso il problema impossibile da ignorare.

La conseguenza operativa è diretta: in un cluster AI ottimizzato per workload dell’AI agentica, il numero di CPU core per gigawatt deve aumentare di 4 volte, da 30 milioni a 120 milioni di core per GW, secondo le stime di Arm CEO Rene Haas. AMD e Intel hanno già ordini inevasi che si estendono da 6 a 10 settimane. I prezzi medi delle CPU sono saliti del 10-15% quest’anno.

ARM è una delle aziende più influenti della storia della tecnologia. È anche una delle meno capite dagli investitori che non seguono i semiconduttori come tema primario, e questo disallineamento tra importanza reale e percezione di mercato è esattamente il tipo di situazione che cerchiamo.

Fondata nel 1990 come spin-off di Acorn Computers, ARM ha sviluppato un’architettura CPU chiamata RISC: Reduced Instruction Set Computing. L’idea era semplice nella descrizione, rivoluzionaria nell’esecuzione. Invece di costruire processori capaci di fare moltissime operazioni diverse, come i chip Intel x86, ARM progettava chip che facevano poche operazioni di base, con una frazione dell’energia richiesta dai competitor.

Per vent’anni questo vantaggio non valeva molto nei data center. ARM viveva nel mobile, dove la batteria è il vincolo supremo, e lì dominava: il 99% degli smartphone del mondo gira su CPU con architettura ARM. Apple M-series, Qualcomm Snapdragon, Samsung Exynos, tutti costruiti su ARM. Non è una quota di mercato: è un monopolio de facto.

Il modello di business che ARM ha costruito su questa posizione è unico nel settore. ARM non produce chip. Non ha fabbriche. Non vende hardware. Vende licenze, il diritto di usare la sua architettura per progettare chip, e raccoglie royalties su ogni chip fisicamente prodotto nel mondo su quella architettura. Ogni iPhone venduto. Ogni Android venduto. Ogni chip automotive con core ARM. ARM prende una percentuale, sempre, indipendentemente da chi ha costruito il chip e chi lo ha comprato.

Il risultato in trent’anni: oltre 350 miliardi di chip prodotti su architettura ARM. Un gross margin del 97-98% sul business licensing e royalties. Una posizione competitiva che non si replica perché è costruita su decenni di ecosystem development, tool, compilatori, librerie software, che rendono ARM l’architettura più facile e meno costosa su cui costruire. Il costo di switching per qualunque azienda che voglia abbandonare ARM è astronomico.

Poi l’energia è diventata il vincolo principale dei data center. E il vantaggio che ARM aveva sviluppato per i telefoni è diventato il vantaggio più prezioso dell’intero ecosistema tech.

Google, Microsoft e Amazon non hanno scelto ARM per i loro chip custom perché erano fan dell’architettura. Hanno scelto ARM perché i numeri erano incontrovertibili. Google dice che Axion offre il 65% di miglioramento nel price-performance e il 60% di efficienza energetica superiore rispetto agli x86. Amazon dice che Graviton è usato da oltre il 90% dei top 1.000 clienti AWS. Microsoft ha costruito Cobalt 100 per spostare i workload Azure più intensivi su ARM.

Questi non sono esperimenti. Sono l’infrastruttura produttiva che gestisce miliardi di richieste al giorno. E ARM raccoglie royalties da ogni chip, indipendentemente da chi vince la gara tra i cloud provider.

Pensala così: Amazon, Google e Microsoft stanno spendendo centinaia di miliardi per costruire infrastruttura. Tutta quella infrastruttura gira su architettura ARM. ARM non deve costruire nulla, non deve vincere nessuna gara, non deve convincere nessun cliente nuovo. Deve solo aspettare le royalties.

È il tipo di posizione che Warren Buffett chiamerebbe un moat. Ma il moat di ARM non è basato sulla fedeltà del cliente, è basato sulla complessità dell’ecosistema. Sostituire ARM richiederebbe ricostruire vent’anni di tool, software, librerie e competenze ingegneristiche. Il costo è semplicemente troppo alto.

Fino al marzo 2026, ARM era l’infrastruttura invisibile. Raccoglieva royalties, non competeva direttamente. Era il fornitore di cui tutti avevano bisogno ma a cui nessuno pensava come competitor.

Poi, all’evento Arm Everywhere, ha cambiato le regole del gioco.

L’AGI CPU, sviluppata in partnership con Meta come primo cliente, dopo due anni e mezzo di co-development, segna la transizione di ARM da fornitore di architetture a produttore diretto di chip fisici. Il nome è volutamente ambizioso: Artificial General Intelligence CPU. Non è un nome tecnico. È una dichiarazione di dove ARM pensa che stia andando il mercato.

La storia dell’origine è rivelatrice. Meta si è avvicinata ad ARM con una richiesta precisa: più core per watt senza compromettere le performance. I fornitori x86 riuscivano a soddisfare uno dei due criteri, mai entrambi. ARM ha accettato la sfida e il risultato è il chip progettato specificamente per risolvere il problema di orchestrazione dell’AI agentica.

I numeri tecnici: l’AGI CPU integra fino a 136 core Neoverse V3 in un design da 300 watt per unità dual-node. I chip AMD EPYC di quinta generazione offrono 128-192 core ma a 390-500 watt in un form factor doppio. In un rack raffreddato ad aria, ARM può impacchettare 8.160 core in 36kW, con prestazioni fino al doppio degli x86 per rack. La versione raffreddata a liquido, sviluppata con Super Micro, arriva a 45.696 core totali in un rack da 200kW. Il dato più eloquente: ARM ha finito lo spazio fisico prima di finire la potenza disponibile. Il rack consuma circa la metà della sua capacità nominale. Il vincolo non è più la corrente, è il volume fisico del rack.

ARM stima che il vantaggio dell’AGI CPU rispetto agli x86 potrebbe abilitare fino a $10 miliardi di risparmio in capex per gigawatt. Per contestualizzare: Microsoft ha appena detto che $25 miliardi del CapEx aggiuntivo 2026 è dovuto al rincaro dei componenti hardware. ARM risolve direttamente quel problema.

Sul lato roadmap: seconda generazione del chip prevista per il 2027, potenziale terza generazione prima del 2031. Un impegno di lungo periodo che segnala una transizione strutturale, non un esperimento.

E poi, mercoledì sera, è arrivata la conferma più concreta che potessimo sperare. Nella press release Amazon Q1 2026, depositata alla SEC, c’è questa frase precisa: “Siglato un accordo con Meta per utilizzare decine di milioni di core AWS Graviton per alimentare i carichi di lavoro intensivi per CPU legati ai suoi progetti di AI agentica, tra cui ragionamento in tempo reale, generazione di codice e workflow multi-step degli agenti“

Meta, l’azienda che ha co-sviluppato l’AGI CPU con ARM, che sta spendendo $125-145 miliardi in CapEx quest’anno, ha scelto Graviton di AWS per i workload di AI agentica. Graviton è architettura ARM. Meta sta dicendo pubblicamente, in un documento SEC, che per l’AI agentica ha bisogno di decine di milioni di core ARM.

Non è una previsione. Non è un’analisi. È una transazione reale, annunciata ufficialmente. La tesi si è validata da sola.

Il modello di business di ARM è strutturalmente unico. Due fonti di revenue: licensing, i pagamenti upfront per accedere all’architettura, e royalties, i pagamenti ricorrenti per ogni chip prodotto nel mondo su quella architettura.

Le royalties sono la parte preziosa: 97-98% di gross margin, crescita sistematica con ogni nuovo chip prodotto globalmente. Nel Q3 FY2026 (dicembre 2025) ARM ha riportato gross margin del 97.6%. L’Annual Contract Value è cresciuto del 28% year-over-year per tre trimestri consecutivi. La consistenza su tre trimestri segnala una tendenza strutturale, non un evento episodico.

Le royalties stanno entrando in una fase di crescita accelerata per due ragioni sovrapposte. La transizione da Armv8 ad Armv9 ha raddoppiato i tassi di royalty per chip. La migrazione verso i Compute Subsystems (CSS) li ha raddoppiati di nuovo. Ogni device che aggiorna la propria architettura porta più revenue royalty ad ARM, non linearmente, ma con un salto di multiplo. Il management guida a un 20% CAGR delle royalties per i prossimi cinque anni.

Sul layer AGI CPU: ARM proietta $1 miliardo di revenue nei prossimi due anni, con la maggior parte nel FY2028. Proiezione a lungo termine: $15 miliardi dall’AGI CPU entro il 2031, su un totale aziendale di $25 miliardi.

Il gap tra consensus ($21.2 miliardi) e guidance management ($25 miliardi) è del 18%. Questo gap è dove si trova il rendimento potenziale asimmetrico, se il management ha ragione.

E qui arriviamo alla parte scomoda per tanti: il multiplo. ARM tratta a un P/S forward di 28.6x. Nvidia è a 11.6x. Broadcom è a 14.4x. ARM è significativamente più cara di qualsiasi peer nel settore.

Questo ci porta direttamente alla domanda di lunedì.

Rispondo subito, senza girarci intorno.

Chi ce l’ha fatta lunedì aveva ragione sui fatti. AVGO oggi ha fondamentali migliori di ARM su quasi ogni metrica tradizionale. Multiplo quasi dimezzato, margini operativi superiori, revenue più diversificata e prevedibile, posizione dominante consolidata su networking ASICs e custom silicon.

Allora perché siamo più interessati ad ARM?

La mia risposta onesta: non siamo “più interessati” nel senso che pensiamo ARM sia il titolo migliore in assoluto. Siamo più interessati perché ARM risponde a una domanda diversa da quella a cui risponde AVGO. E confondere le due domande è il modo più rapido per prendere la decisione sbagliata su entrambe.

Il confronto diretto ARM vs AVGO presuppone che tu stia cercando la risposta a questa domanda: “quale dei due è il titolo migliore?” Ma questa è la domanda dell’analista che compila un report, non dell’investitore che costruisce un portafoglio.

AVGO offre qualità comprovata: revenue prevedibile, margini difendibili, dividendo in crescita, posizione dominante in nicchie difficili da replicare. Se il tuo portafoglio ha bisogno di esposizione ai semiconduttori AI con rischio contenuto e rendimento stabile, Broadcom risponde a questa esigenza meglio di quasi qualsiasi alternativa.

ARM offre asimmetria: se la tesi sull’AI agentica e sul vincolo energetico è corretta nei tempi, ARM a questi prezzi incorpora un potenziale che il consensus non ha ancora prezzato completamente. Ma quella asimmetria porta volatilità e rischio di esecuzione significativamente più alti.

Non sono investimenti in competizione. Sono risposte a domande diverse. Tenerli entrambi con pesi e ragioni diverse può avere senso. Scegliere uno escludendo l’altro senza un framework chiaro è quasi sempre la decisione sbagliata.

Broadcom è già riconosciuta come AI winner. Il mercato l’ha già prezzata in modo significativo. Per continuare a battere il mercato da qui, AVGO deve continuare a eseguire alla perfezione in un contesto dove le aspettative sono già alte. Non è impossibile, ma il margine di errore è ridotto.

ARM sta ancora costruendo la propria narrativa da AI winner nei data center. Il mercato riconosce la forza del licensing mobile. Non ha ancora completamente prezzato tre fattori sovrapposti: la transizione verso l’AI agentica che aumenta la domanda di CPU core, il vincolo energetico che favorisce strutturalmente ARM, e il lancio dell’AGI CPU che trasforma ARM da fornitore di IP a produttore di chip con margini diretti.

Il consensus degli analisti è sotto le guidance del management del 18%. Quel gap è dove si trova il rendimento potenziale asimmetrico.

Il moat di Broadcom richiede esecuzione continua: deve continuare a vincere le gare per i nuovi chip custom, deve innovare sui prodotti di networking, deve mantenere le relazioni con Google e Meta che hanno le risorse per sviluppare alternative interne.

Il moat di ARM funziona diversamente. ARM raccoglie royalties su ogni chip prodotto su architettura ARM, indipendentemente da chi vince la gara tra i produttori. Se Google, Microsoft, Amazon, Meta e Nvidia continuano a costruire su architettura ARM, ARM vince comunque, senza dover vincere nessuna gara individuale.

Per capirci: Broadcom possiede un negozio su una strada commerciale molto frequentata. Deve servire bene ogni cliente per restare in piedi. ARM possiede la strada. Ogni volta che qualcuno passa, qualunque negozio stia andando a visitare, paga un pedaggio ad ARM.

Con l’AI agentica che richiede 4 volte più CPU core per gigawatt, il traffico su quella strada è destinato ad aumentare in modo significativo. La conferma di mercoledì sera, l’accordo Amazon-Meta su decine di milioni di core Graviton per workload agentici, non è una proiezione. È il traffico che ha già iniziato a scorrere.

Se stai leggendo questo e ti stai chiedendo se sei già posizionato correttamente rispetto a quello che stiamo descrivendo, quella è esattamente la domanda giusta da fare adesso.

Non alla fine della newsletter. Adesso.

Oppure continua a leggere, la parte più importante arriva subito dopo.

Mercoledì sera, nelle quattro conference call, sono emersi segnali che confermano la tesi in modo più diretto di qualsiasi analisi interna.

Google Cloud +63% con Pichai che dice esplicitamente di non riuscire a soddisfare tutta la domanda. Microsoft con Azure che re-accelera al 40% e Hood che dichiara di aspettarsi di restare “supply constrained” per tutto il 2026. Amazon con AWS +28% e il chips business che supera i $20 miliardi annualizzati con crescita triple digit. Tutti convergono sullo stesso messaggio: la domanda supera l’offerta, e chi riesce a costruire capacità più velocemente vince.

Nel mezzo di questo ecosistema, AMD e Intel si trovano in una posizione strutturalmente più complessa. Nel breve termine i loro backlog crescono e i prezzi aumentano, segnale di domanda superiore all’offerta. Ma quella domanda è in parte sostitutiva e temporanea: quando Google, Microsoft e Amazon hanno bisogno di più CPU adesso, comprano x86 perché non ci sono ancora abbastanza CPU ARM disponibili in scala. Nel lungo termine, ogni nuovo data center che costruiscono da zero userà architettura ARM.

AMD e Intel vincono il breve termine. ARM probabilmente sarà un avversario molto duro per il lungo. E il lungo termine è dove si costruisce il rendimento strutturale.

Non presentiamo mai una tesi senza presentare i rischi con la stessa chiarezza. Chi dice solo le cose positive sta facendo marketing. Noi facciamo ricerca.

Questi rischi non invalidano la tesi. La rendono onesta. Una cosa positiva però: le trimestrali di mercoledì hanno ridotto concretamente il rischio “tesi giusta ma timing lontano.” L’accordo Amazon-Meta su decine di milioni di core Graviton per workload agentici è una transazione già annunciata. Non è futuro, è presente.

Sei arrivato alla fine. Hai dedicato tempo a capire un tema che il 95% degli investitori italiani non ha ancora messo a fuoco in modo coerente. Questo da solo ti mette in una posizione diversa.

Ma capire non è abbastanza. Tra capire e agire ci sono domande precise che dipendono dalla tua situazione specifica, non dall’analisi generale che hai appena letto.

01 — Il mio portafoglio è costruito per il ciclo del CapEx efficiente, o per quello del CapEx massiccio? Non è la stessa cosa. I vincitori del ciclo 2023-25 erano le aziende che beneficiavano della spesa AI in volume. Il ciclo che si sta aprendo premia chi produce di più con meno energia e meno capitale. Sai qual è la differenza nel tuo portafoglio attuale?

02 — Ho esposizione al layer CPU dei semiconduttori AI, o solo alle GPU? Non necessariamente sbagliato nel breve, Nvidia rimane un’azienda unica e straordinaria. Ma avere solo GPU e nessuna esposizione alla transizione verso l’AI agentica significa ignorare il tema più grande del prossimo triennio.

03 — Ho una risposta chiara alla domanda ARM vs AVGO per il mio profilo specifico? Non la risposta giusta in assoluto, quella non esiste. La tua risposta, per il tuo orizzonte e il tuo portafoglio. Se non ce l’hai, questa è l’informazione più utile che porti via da questa newsletter.

04 — So gestire “tesi corretta, timing incerto”? ARM potrebbe essere giusta come tesi e fare male nei prossimi dodici mesi se il multiplo si comprime prima che i numeri arrivino. Come gestisci questa possibilità? Con quale dimensione di posizione? Con quale stop? Senza risposta a questa domanda, l’analisi fondamentale non basta.

05 — I dati CapEx di questa settimana hanno cambiato qualcosa nel mio posizionamento? Se hai un framework, i dati delle trimestrali confermano o smentiscono parti specifiche di quel framework. Se non hai un framework, i dati sono solo notizie, interessanti ma non azionabili.

Se sei arrivato alla fine di questa newsletter con almeno due domande aperte nella testa, quella è esattamente la condizione giusta per una conversazione utile. Le domande aperte non si rispondono con un’altra newsletter.

Prenota una call gratuita con noi per capire insieme se ciò che hai fatto ha già risposto alle cinque domande di questa newsletter. Se sì, te lo diciamo. Se no, capirai esattamente cosa ti sei perso fino a questo momento, e se ha senso fare qualcosa al riguardo.

👉 Contattaci per una call gratuita QUI

👉Numero Verde: 800 657 110

👉Email: info@trendpositioning.com

Efisio Garau

Head of Fundamental Analysis

TPRI | TP Invest